မနေ့က ရေးခဲ့တဲ့ AI အကြောင်းကို သဘောကျကြလို့ ဝမ်းသာပါတယ်။

Artificial Intelligence (AI) နဲ့လူတွေ သဟဇာတဖြစ်နိုင်လား?

https://ouo.io/8MkZSqR

အဲ့ဒါကြောင့် အခုနောက်တစ်ပုဒ် ထပ်ရေးလိုက်ပါတယ်။ ဒီအပုဒ်မှာတော့ လူတွေလို တွေးခေါ်တတ်တဲ့ AI တွေမှာ ဘာတွေလိုမလဲ… လူတွေအပေါ်ဘယ်လို အကျိုးသက်ရောက်မှုတွေရှိမလဲ ဆွေးနွေးသွားမှာပါ။

ပညာရှင်တွေကတော့ AI ပြဿနာဟာ Trial & Error သဘောနဲ့ သွားမရဘူးလို့ ပြောကြပါတယ်။ အဓိကကတော့ ဖြစ်ပြီးရင် ပြန်ပြင်လို့မရဘူးလို့ ပြောချင်တာပါ။ ဒီတော့ တခါတည်းနဲ့ မှန်ကန်အောင် ကြံစထားနိုင်ဖို့ လိုပါတယ်။

ပညာရှင်တစ်ယောက်က ဘယ်လောက်ထိ ပြောထားလဲဆိုရင် “AI တွေဟာ လူတွေကို မမုန်းသလို ချစ်လည်းမချစ်ပါဘူး။ ဒါပေမယ့် သင်ဟာ သူတို့အတွက် တစ်နေရာရာမှာ သုံးလို့ရမယ့် Atom တွေနဲ့ဖွဲ့စည်းထားပါတယ်” လို့ပြောပါတယ်။

ဆိုလိုချင်တာက လူကို AI ကနားမလည်ပေမယ့် လူကိုတည်ဆောက်ထားတဲ့ Atom တွေကို လိုချင်ရင် လူကို ရန်ပြုလာနိုင်တယ်လို့ ပြောချင်တာပါ။

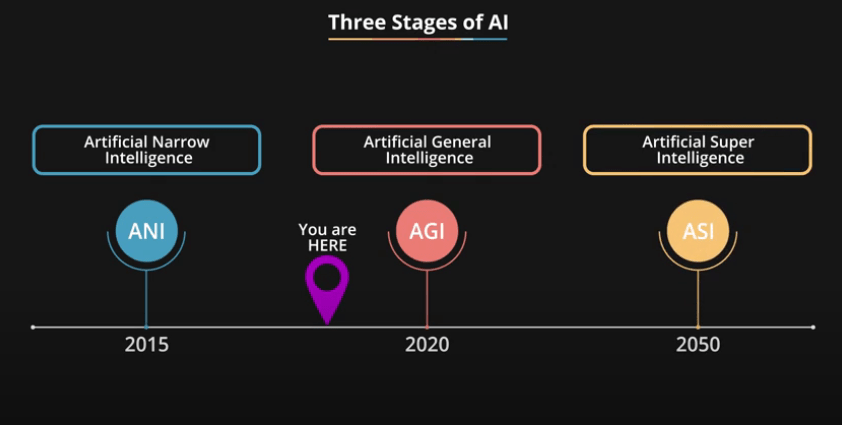

အရင်အပုဒ်မှာ ASI (Artificial Superintelligence) အကြောင်း Thought Experiment တစ်ခုနဲ့ပြောခဲ့ပါတယ်။ လက်တွေ့မှာ အဲ့လိုမရှိသေးပါဘူး။ ကုန်ကုန်ပြောရရင် လူနဲ့အပြိုင်တွေးခေါ်နိုင်တဲ့ AI တောင်မပေါ်သေးပါဘူး။ ဒါကိုတော့ AGI (Artificial General Intelligence) လို့ခေါ်ပါတယ်။ ASI မဖြစ်ခင် တစ်ဆင့်အလိုဆိုပါတော့။

လူတွေအခုသုံးနေတဲ့ AI တွေဟာ Google ရှာတာလောက်၊ Stock တွေအရောင်းအဝယ် လုပ်တာလောက်၊ အသံကိုနားထောင်ပြီး Task တွေလုပ်ပေးတာလောက်ပဲ အသုံးကျသေးတာပါ။ ဒါတွေကိုတော့ ANI (Artificial Narrow Intelligence) လို့ခေါ်ပါတယ်။

ဒါပေမယ့် လူတွေလို တွေးနိုင်၊ အလုပ်လုပ်နိုင်တဲ့ AGI တွေကို မြင်ကြည့်ပါ။ ၂၄နာရီပတ်လုံး မအိပ်ဘဲ၊ မနားဘဲနဲ့ သုတေသနလုပ်နိုင်တဲ့ Ph.D. အယောက် ၁၀၀ လောက်ပေါင်းပြီး ပြဿနာတစ်ခုကို အဖြေရှာတဲ့အခါ အရာရာဟာ ခပ်မြန်မြန်တိုးတက်လာဖို့ ရှိပါတယ်။ AGI တွေဟာ ဒီသဘောပါပဲ။

ဒီတော့ မေးစရာတစ်ခုရှိတာက လူတွေလို တွေးခေါ်တတ်တယ်ဆိုတာ ဘာလဲ? လူနဲ့ တူတဲ့ AGI မှာ ဘယ်လိုဂုဏ်သတ္တိတွေ ရှိဖို့ လိုမလဲ?

ကားမောင်းနိုင်တယ်၊ ပစ္စည်းပေါင်းမြောက်များစွာကို ကြည့်ရုံနဲ့ ခွဲခြားနိုင်တယ်၊ ကိုင်ကြည့်လိုက်ရင် သူတို့ရဲ့ Texture ကိုသိတယ်၊ အင်တာနက်သုံးတတ်တယ်၊ ဘာသာစကားပေါင်းစုံ သင်ယူလို့ရတယ်၊ ကျွမ်းကျွမ်းကျင်ကျင်ပြောဆိုနိုင်တယ်၊ ပတ်ဝန်းကျင်နဲ့ လိုက်လျောညီထွေဖြစ်အောင် နေတတ်တယ်၊ Multitasking လုပ်နိုင်တယ်၊ ကိုယ့်ကိုကိုယ် တိုးတက်အောင်လုပ်နိုင်တယ်၊ Skill အသစ်တွေသင်ယူနိုင်တယ်… စသဖြင့် အများကြီးပါပဲ။

ဒါဆိုရင် AGI တွေဖြစ်လာအောင် ဘယ်လောက်ကြာဦးမလဲ? ပညာရှင်တွေကတော့ ၂၀၂၈ မတိုင်ခင်မှာ ဖြစ်လာဖို့ ၁၀% Chance ရှိတယ်၊ ၂၀၅၀ မတိုင်ခင်ဖြစ်လာဖို့ ၅၀% Chance ရှိတယ်၊ ၂၁၀၀ ခုနှစ်မကုန်ခင်ဖြစ်လာဖို့ ၉၀% ရှိတယ်လို့ ပြောကြပါတယ်။

ဒါ့အပြင် စစ်တပ်တွေနဲ့ လုပ်ငန်းကြီးတွေဟာ အခြားအဖွဲ့အစည်းတွေထက် AGI ကို အရင်ဆုံးစမ်းသပ်အောင်မြင်ဖို့ များတယ်လို့ ဆိုပါတယ်။ Budget များများသုံးနိုင်တာကြောင့်ပါ။

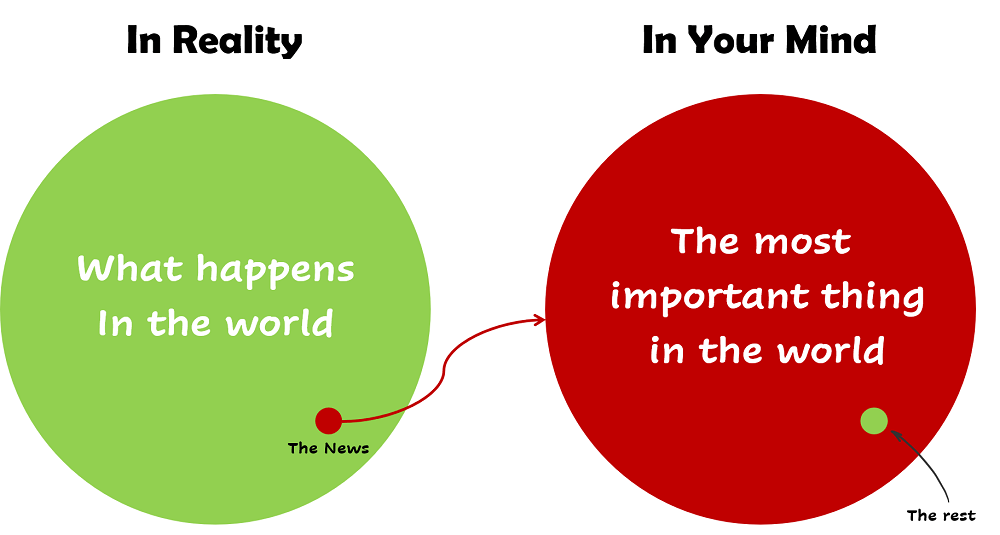

AI အကြောင်းကို ပညာရှင်တွေနဲ့ နည်းပညာကျွမ်းကျင်တဲ့ သူတွေက လွဲရင် အခြားနေရာတွေမှာ သိပ်မပြောကြပါဘူး။ အကြောင်းကတော့ Hollywood ကရိုက်တဲ့ ဇာတ်လမ်းတွေကြောင့် ဖြစ်နိုင်ပါတယ်။

အခုပြောခဲ့တဲ့အကြောင်းတွေကို မယုံတစ်ဝက်နဲ့ ဖတ်နေကြမယ့်သူတွေ တော်တော်များမယ်လို့ ထင်ပါတယ်။ စက်ရုပ်တွေက ကမ္ဘာကိုဖျက်ဆီးမယ်ဆိုတာ အပေါ်ယံကြည့်လိုက်ရင်တော့ မဖြစ်နိုင်သလိုပါပဲ။

ဒါဟာ ပြဿနာကို ထဲထဲဝင်ဝင် နားမလည်တဲ့အခါမှာ ဖြစ်နိုင်ပါတယ်။ ဒီကိစ္စတွေကို Serious ထားပြီး ဆွေးနွေးတာဟာ ပညာရှင်အသိုင်းအဝိုင်းမှာပဲ ဖြစ်နေပါတယ်။

စိတ်ပညာအရတော့ ဒါဟာ လူတွေရဲ့ Cognitive Bias တွေကြောင့်လို့ ရှင်းပြလို့ရပါတယ်။ ကိုယ်က ကားတိုက်ခံရမလို ဖြစ်ပြီး နောက်ရက်မှာ “ဘယ်အရာနဲ့ မတော်တဆဖြစ်ပြီး သေနိုင်လဲ” လို့ လာမေးရင် ကားတိုက်ခံရတာကို ဖြစ်တန်စွမ်းများတဲ့နေရာမှာ ထားကြဖို့ များပါတယ်။ ဒါကို Availability Bias လို့ခေါ်ပါတယ်။

ကိုယ့်မှာ ဖြစ်တော့ တော်တော်အဖြစ်များတာပဲဆိုပြီး ထင်သွားတာမျိုးပါ။

နယူကလီးယားဗုံးတွေ ဘယ်လောက်ဆိုးလဲဆိုတာ ဒုတိယကမ္ဘာစစ်တုန်းက မြင်ခဲ့ရပါတယ်။ ဒါ့အပြင် နယူကလီးယား Power Plant တွေကိုလည်း သတိကြီးကြီးထား ကိုင်တွယ်ဖို့လိုကြောင်း ရုရှားရဲ့ Chernobyl တို့၊ ဂျပန်ရဲ့ ဖူကူရှီးမားတို့က သက်သေခံနေပါတယ်။

ဒါပေမယ့် AGI တွေ၊ ASI တွေကိုတော့ ဇာတ်လမ်းထဲမှာပဲ ဆိုးတယ်လို့ မြင်နေကြတာပါ။ အပြင်မှာ လက်တွေ့ပြစရာမရှိပါဘူး။ Thought Experiment တွေနဲ့ပဲ ပြောနိုင်ပါတယ်။

Trial & Error သဘောနဲ့ အမှားတွေကို ပြန်ပြင်ဖို့ ဖြစ်ချင်မှဖြစ်နိုင်မယ်ဆိုပြီး အပေါ်မှာ ပြောခဲ့ပါတယ်။ AI တွေမှာ ဒီပြဿနာက ကြီးပါတယ်။ နယူကလီးယားဗုံးပေါက်တာ၊ Nuclear Power Plant မတော်တဆမှုတွေ ဖြစ်တာဟာ နေရာတစ်ခုတည်းပါပဲ။ နေရာစုံမှာ မဖြစ်သ၍ ကမ္ဘာကြီးပျက်မသွားနိုင်ပါဘူး။

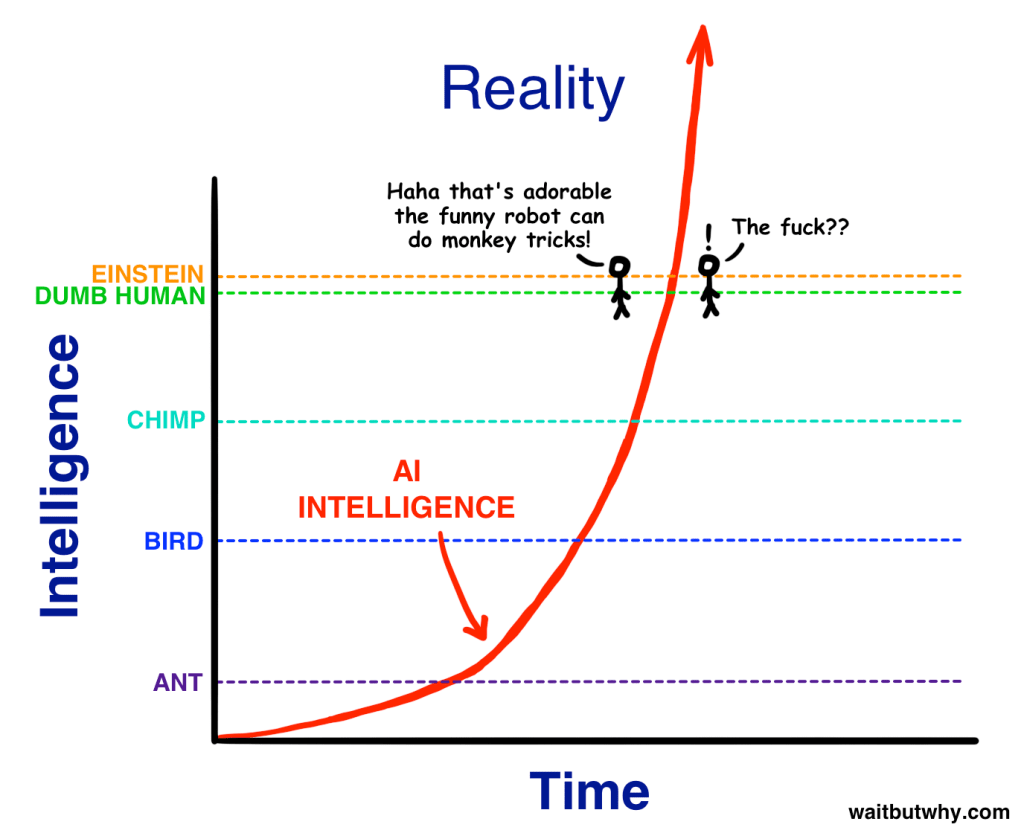

AI တွေကတော့ သူတို့ကိုယ်သူတို့ Improve ဖြစ်အောင် ခပ်မြန်မြန် လုပ်နိုင်ပါတယ်။

အဲ့တော့ လူတွေထက် ပိုပြီးတွေးခေါ်မျှော်မြင်နိုင်တဲ့ ASI တွေကို ဘယ်လိုထိန်းချုပ်နိုင်မလဲ?

ဒါကို Singularity လို့ခေါ်ပါတယ်။ Big Bang Theory ထဲက Singularity သဘောနဲ့ တူပါတယ်။ ပြောချင်တာက အချိန်တစ်ခု (Singular Period of Time) ကစပြီး အဲ့ဒီနောက်ပိုင်းဖြစ်လာသမျှကို ပြန်ပြောင်းလဲလို့ မရတော့ပါဘူး။ လူတွေရဲ့ ကောင်းခြင်း၊ ဆိုးခြင်းတွေဟာ သူတို့အပေါ်များစွာ မူတည်သွားပါပြီ။

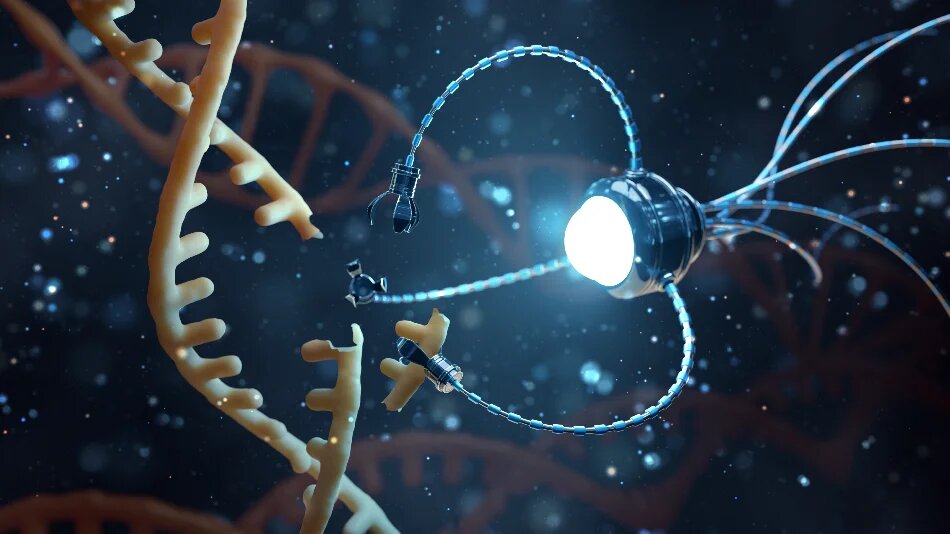

AI တွေကို Nano နည်းပညာတွေ ကိုင်တွယ်ဖို့ ပညာရှင်တွေက ရည်ရွယ်ပါတယ်။ တချို့ဆိုရင် Nano နည်းပညာမတိုးတက်ခင် ASI တွေအရင်တိုးတက်လာသင့်တယ်… ဘာလို့လဲဆိုတော့ လူတွေရဲ့ဦးနှောက်နဲ့ Nano နည်းပညာကို ကိုင်တွယ်ဖို့ မလွယ်ဘူးလို့ ဆိုပါတယ်။

Nano နည်းပညာကို အသုံးပြုနိုင်ရင် ဖြစ်လာနိုင်တဲ့ ကောင်းကျိုးတွေ တော်တော်များပါတယ်။ Immortality ရနိုင်တယ်၊ VR တွေက ပိုပြီး Immersive ဖြစ်လာမယ်၊ ကိုယ့်ရဲ့ စိတ်ကို ကွန်ပြူတာပေါ် Upload လုပ်လို့ရကောင်း ရနိုင်တယ်။

ဒီတော့ AI တွေကို လုံးဝပစ်ပယ်လို့ မရပါဘူး။ ဒါပေမယ့် အကောင်းဘက်က မြင်ကြတဲ့သူတွေလည်း ရှိပါတယ်။ ဥပမာ AGI တွေနဲ့တော့ လူတွေယှဉ်လို့ရပါတယ်။ အဲ့ဒီအခါ သူတို့နဲ့ ယှဉ်တွဲနေထိုင်ရင်း သူတို့ကို ဘယ်လိုကိုင်တွယ်ရမလဲဆိုတာကို အဖြေရှာလို့ ရနိုင်ပါတယ်။

ပြောချင်တာက နွားလှည်းသုံးတဲ့ခေတ်မှာနေပြီး ကားဘယ်လိုမောင်းရမလဲဆိုတာ အဖြေရှာလို့ မရသလိုပါပဲ။

ဒါပေမယ့် ဒီအမြင်ဟာ AGI တွေရဲ့ တိုးတက်နှုန်းနှေးတယ်လို့ ယူဆထားပါတယ်။ ပညာရှင်အချို့ကတော့ AGI ကနေ ASI ပြောင်းဖို့ ရက်ပိုင်းပဲ ကြာလိမ့်မယ်လို့ ပြောပါတယ်။ အရင်အပုဒ်မှာ ရေးခဲ့တဲ့ Busy Child Scenario လိုပါပဲ။ ဒါကို Intelligent Explosion လို့ခေါ်ပါတယ်။

ဒီတော့ အမှားခံလို့မရဘူး။ ဘယ်လောက်ပဲသေးငယ်တဲ့ ဖြစ်တန်စွမ်းတစ်ခု ဖြစ်ပါစေ သေချာစဉ်းစားပြီးမှ ရှေ့ဆက်ရမှာပါ။ ဥပမာ အင်္ဂါဂြိုလ်ပေါ်ကို Mars Rover တွေလွှတ်တဲ့အခါ ဖြစ်တန်စွမ်းမှန်သမျှကို ကြိုတင်စဉ်းစားပြီး အကုန်လုံးအတွက် ဖြေရှင်းချက်တွေ ထည့်ထားပါတယ်။ AGI တွေကို မတီထွင်ခင် ပြဿနာမှန်သမျှကို Troubleshoot လုပ်ထားဖို့ လိုပါတယ်။

Silicon Valley မှာတော့ ဒီ Hypothetical အခြေအနေတစ်ခုကို စမ်းသပ်ပြတာ နာမည်ကြီးပါတယ်။ AI-Box Experiment လို့ခေါ်ပါတယ်။ ဒီစမ်းသပ်မှုမှာ Genius တစ်ယောက်က AI နေရာကနေပါတယ်။ သူ့ကိုတားဖို့ တစ်ဖက်က “လူ” နေရာမှာ နေတာက Silicon Valley ရဲ့ မီလီယံနာသူဌေးကြီးတွေပါ။

AI နဲ့ လူနဲ့ကြားမှာ Chat လို့ရအောင် လုပ်ပေးထားပါတယ်။ Genius က ကီးဘုတ်တစ်လုံးပဲ အသုံးပြုပြီး “လူ” တွေကို လိမ်ညာပြီး သူတို့ရဲ့ ထိန်းချုပ်မှုအောက်ကနေ အမြဲလွတ်လွတ်သွားပါတယ်။

သူတောင်မှ တစ်ဖက်လူတွေကို လိမ်နိုင်ရင် လူတွေထက် အဆပေါင်း ရာထောင်ချီပြီး တွေးခေါ်နိုင်တဲ့ ASI တွေဆို လူတွေကို ဘယ်လောက်လွယ်လွယ်နဲ့ လိမ်လို့ရမလဲဆိုတာ မေးခွန်းထုတ်စရာ ဖြစ်လာတာပေါ့။

ဒါကြောင့် AI ပြဿနာဟာ ခေါင်းစားစရာ ဖြစ်နေတာပါ။

ကျွန်တော်တို့ သက်တမ်းစေ့နေနိုင်ခဲ့ရင်တော့ AGI အဆင့်လောက်ရှိတဲ့ AI ကိုတွေ့ဖို့ မျှော်လင့်မိပါတယ်။ အမှန်တကယ်လည်း ဒီလို ဖြစ်လာနိုင်မယ်လို့ ထင်ပါတယ်။

ဖတ်မိတာ ရှိရင် AI အကြောင်းဆက်ရေးပါဦးမယ်။

SAGAN

Next Post, Previous Post မနှိပ်ဘဲ OUO Link ကနေ ၁ပုဒ်ချင်းဝင်ဖတ်ပြီး ကူညီပါ။

အသိအမြင်၊ အတွေးအခေါ် အသစ်တစ်ခုခုရသွားလို့ လှူဒါန်းလိုပါက Science Nuts (Facebook Page) ကို ဆက်သွယ်လှူဒါန်းနိုင်ပါတယ်။

လှူသမျှငွေအကုန်လုံးကို လိုအပ်တဲ့နေရာတွေမှာ ပြန်လည်လှူဒါန်းပေးသွားမှာပါ။